安全组隔离是云网络安全架构中的核心机制,通过虚拟防火墙规则实现不同云资源间的网络访问控制,确保资源间的安全边界,在云计算环境中,多个虚拟机、容器、数据库等资源可能共享同一物理底层,安全组隔离通过定义精细化的访问策略,有效防止未授权访问、数据泄露及横向攻击,是构建零信任安全体系的基础组件。

安全组隔离的核心原理在于“默认拒绝,允许例外”,每个安全组包含一组入方向和出方向规则,入方向规则控制外部流量访问安全组内的资源,出方向规则控制安全组内资源访问外部流量,未匹配任何允许规则的流量将被自动拒绝,形成天然的隔离屏障,默认情况下,安全组内的资源无法被公网IP访问,也无法主动访问其他安全组的资源,除非通过显式授权建立连接。

实现安全组隔离需结合网络协议、端口范围和源/目的IP地址等要素进行规则配置,以云服务器为例,若需运行Web服务,可配置入方向规则允许TCP协议的80(HTTP)和443(HTTPS)端口,源IP设置为0.0.0.0/0(允许所有公网访问)或特定IP段;若需保护数据库,则仅允许应用服务器的私有IP访问3306端口,并拒绝其他所有IP的访问,以下是典型隔离场景的规则配置示例:

| 场景 | 规则方向 | 协议 | 端口范围 | 源/目的IP | 效果 |

|---|---|---|---|---|---|

| Web服务公网访问 | 入方向 | TCP | 80,443 | 0.0.0/0 | 允许外部访问HTTP/HTTPS |

| 数据库安全隔离 | 入方向 | TCP | 3306 | 应用服务器IP | 仅允许应用服务器访问数据库 |

| 测试环境内部互通 | 出方向 | ALL | ALL | 测试网段IP | 允许访问测试环境其他资源 |

| 恶意IP封禁 | 入方向 | ALL | ALL | 恶意IP | 拒绝该IP的所有访问请求 |

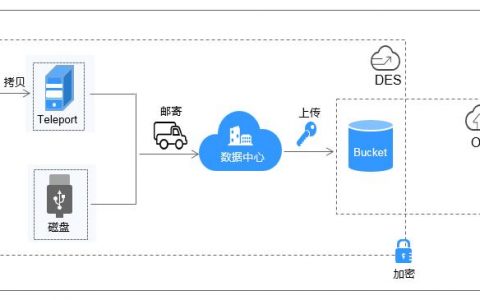

安全组隔离在多租户、多环境及敏感业务保护中应用广泛,在多租户场景下,不同租户的资源可分配至不同安全组,通过规则确保租户间数据互不泄露;测试与生产环境隔离可避免测试流量影响生产业务,例如生产环境安全组仅开放必要端口,测试环境则允许更灵活的访问;对于金融、医疗等敏感业务,数据库、API网关等核心组件可通过安全组严格限制访问来源,降低数据泄露风险。

配置安全组隔离时需遵循最小权限原则,避免过度开放端口;同时注意规则顺序,云平台通常按优先级顺序匹配规则,高优先级规则(如精确IP)应置于低优先级规则(如0.0.0.0/0)之前,安全组隔离需与网络ACL(子网级别防火墙)、操作系统防火墙协同,形成“网络-主机”双重防护,避免单点故障导致隔离失效。

相关问答FAQs

Q1:安全组隔离和物理隔离有什么区别?

A:安全组隔离是虚拟层面的逻辑隔离,基于云平台规则动态控制流量,具有配置灵活、成本低、易于扩展的特点,适合云环境快速部署;物理隔离则是通过物理设备(如独立服务器、专线)实现网络完全分离,安全性更高但成本高昂、管理复杂,适用于对数据合规性要求极高的场景(如政府、金融核心系统),安全组隔离更适合云上业务的动态防护需求。

Q2:如何判断安全组隔离规则是否生效?

A:可通过三种方式验证:1)云平台提供的网络日志服务(如VPC Flow Logs),查看被允许或拒绝的流量记录;2)在安全组关联的云主机上使用telnet、nc等工具测试端口连通性,例如telnet 公网IP 80验证Web服务是否可访问;3)结合云监控工具,设置安全组规则命中次数告警,实时监控异常流量,若规则未生效,需检查规则方向(入/出方向)、协议、端口及IP地址是否配置正确,并确认资源已正确绑定安全组。

【版权声明】:本站所有内容均来自网络,若无意侵犯到您的权利,请及时与我们联系将尽快删除相关内容!

发表回复